Ketika Platform AI seperti Hugging Face makin agresif memperluas akses ke model kecerdasan buatan yang open source, dampaknya terasa jauh melampaui laboratorium riset. Ia masuk ke ruang kelas, studio kreatif, startup yang baru mencari pasar, hingga tim data di perusahaan mapan yang butuh efisiensi. Di tengah perlombaan teknologi AI global—dari model bahasa, visi komputer, sampai audio—ekosistem terbuka menawarkan sesuatu yang tak selalu bisa dibeli dengan lisensi mahal: transparansi, kemampuan audit, dan kebebasan mengutak-atik. Namun “terbuka” juga menuntut kedewasaan: kurasi, keamanan, tata kelola, dan literasi. Di Indonesia, banyak tim kecil mulai meniru pola kerja komunitas global: mengambil model yang tersedia, menguji ulang pada data lokal, lalu merilis perbaikan agar dapat dipakai ulang. Pada titik inilah perluasan akses bukan hanya soal tombol unduh, melainkan tentang membangun kebiasaan baru dalam pengembangan AI—lebih kolaboratif, lebih cepat, dan lebih terukur.

Bayangkan kisah fiktif namun realistis: tim rintisan “SagaraLab” yang mengembangkan asisten layanan pelanggan berbahasa Indonesia. Mereka tidak memulai dari nol. Mereka memanfaatkan repositori model, dataset, dan demo untuk bereksperimen, lalu menggabungkan praktik pembelajaran mesin modern seperti fine-tuning, evaluasi bias, dan pengujian robust. Dalam beberapa minggu, mereka sudah punya prototipe yang bisa dipresentasikan ke klien. Setahun lalu, pekerjaan serupa mungkin memakan waktu berbulan-bulan. Perubahan ritme inilah yang membuat diskusi tentang Hugging Face dan akses open source relevan: siapa pun kini bisa masuk, tetapi tidak semua orang siap menghadapi konsekuensinya. Dari sini, kita masuk ke detail: bagaimana perluasan akses bekerja, siapa yang diuntungkan, apa risikonya, dan bagaimana menyiapkan organisasi agar tidak sekadar ikut tren.

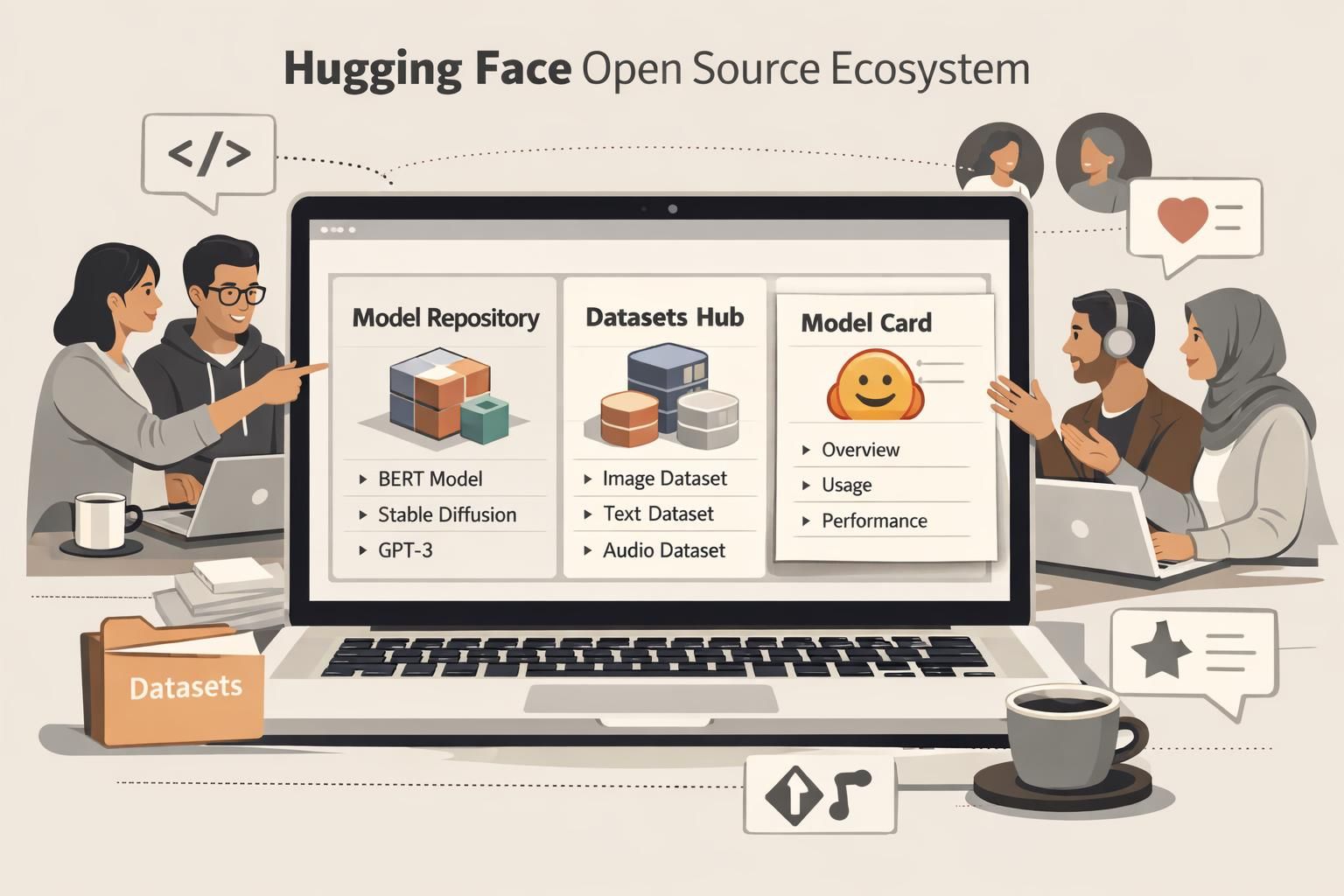

Ekspansi Platform AI Hugging Face: cara akses model kecerdasan buatan open source makin mudah

Pada praktiknya, perluasan akses di Platform AI seperti Hugging Face terjadi lewat tiga jalur yang saling menguatkan: penyederhanaan distribusi model, standarisasi proses eksperimen, dan penguatan peran komunitas AI. Dulu, tim data sering terjebak di “jurang implementasi”: model ada di paper, kode sulit direproduksi, dependensi berantakan, dan dokumentasi minim. Kini, repositori yang rapi, kartu model, contoh penggunaan, serta ruang diskusi membuat proses “dari ide ke prototipe” lebih singkat. Dampaknya terasa besar bagi tim seperti SagaraLab: mereka bisa membandingkan beberapa arsitektur, menjalankan inferensi awal, lalu memilih model dengan rasio akurasi-biaya yang paling masuk akal.

Perluasan akses juga berarti munculnya banyak “jalur cepat” untuk pengguna non-peneliti. Di ekosistem modern, alat AI bukan hanya library untuk Python. Ada demo interaktif, pipeline siap pakai, dan template pelatihan yang memandu langkah demi langkah. Bagi perusahaan yang baru membangun tim data, ini mengurangi risiko salah strategi di awal. Alih-alih menghabiskan bulan pertama untuk menata lingkungan, mereka bisa langsung fokus pada pertanyaan bisnis: metrik apa yang penting, data apa yang sensitif, dan di mana AI benar-benar menambah nilai.

Standar dokumentasi: kartu model, lisensi, dan jejak evaluasi

Salah satu perubahan paling terasa adalah semakin seriusnya dokumentasi. Kartu model tidak sekadar formalitas, tetapi menjadi “paspor” yang menjelaskan tujuan, batasan, sumber data, serta potensi bias. Ini krusial saat open source makin populer: semakin banyak pihak memakai model untuk konteks baru, semakin tinggi risiko salah pakai. Misalnya, model yang dilatih untuk bahasa informal bisa gagal saat dipakai untuk dokumen hukum, atau sebaliknya. Dengan dokumentasi yang lebih matang, tim SagaraLab bisa mengambil keputusan yang bisa dipertanggungjawabkan: mengapa model A dipilih, apa risikonya, dan bagaimana mitigasinya.

Di sisi lisensi, perluasan akses menuntut literasi. “Open source” bukan satu jenis. Ada lisensi yang permisif, ada yang membatasi penggunaan komersial, ada pula yang mewajibkan atribusi atau berbagi perubahan. Untuk organisasi, membaca lisensi adalah bagian dari tata kelola, bukan urusan tim legal semata. Dalam ekosistem teknologi AI, kesalahan kecil soal lisensi bisa berubah menjadi masalah reputasi. Insightnya: akses yang luas hanya bermanfaat bila disertai disiplin penggunaan.

Contoh lintas industri: dari kamera ponsel hingga sistem pencarian

Perluasan akses model juga terlihat dari cara industri mengadopsi AI di produk sehari-hari. Kamera ponsel, misalnya, makin mengandalkan pemrosesan cerdas untuk mengurangi noise, menyeimbangkan warna, dan memperbaiki detail. Pola adopsi ini relevan karena komunitas open source sering menjadi tempat uji ide sebelum masuk produk massal. Untuk melihat bagaimana AI memengaruhi pengalaman kamera pada perangkat konsumen, salah satu rujukan menarik adalah pembahasan AI kamera di lini Galaxy. Ini membantu kita memahami hubungan antara riset terbuka dan fitur yang akhirnya dinikmati pengguna.

Hal serupa terjadi pada pencarian informasi: sistem modern menggunakan ranking cerdas, pemahaman konteks, serta ringkasan yang lebih relevan. Ketika model dan teknik dieksplorasi secara terbuka, inovasi bergerak lebih cepat. Untuk perspektif tentang bagaimana pencarian makin akurat dengan AI, lihat ulasan peningkatan pencarian berbasis AI. Pelajarannya jelas: akses open source menciptakan “pasar ide” yang membuat evolusi produk lebih dinamis.

Bagian berikutnya akan mengupas bagaimana perluasan akses ini mengubah cara tim melakukan pembelajaran mesin dari sisi teknis dan operasional, termasuk praktik evaluasi dan penerapan di lingkungan nyata.

Pembelajaran mesin yang lebih terjangkau: dampak akses open source terhadap pengembangan AI

Ketika akses ke model kecerdasan buatan open source melebar, perubahan utamanya bukan sekadar “lebih banyak model tersedia”. Yang benar-benar bergeser adalah cara tim melakukan pembelajaran mesin: lebih iteratif, lebih berbasis evaluasi, dan lebih modular. SagaraLab, misalnya, tidak lagi membangun sistem monolitik. Mereka menyusun pipeline: pemrosesan data, embedding, retriever, model generatif, lalu layer verifikasi. Pendekatan modular ini memudahkan penggantian komponen tanpa menulis ulang semuanya. Saat ada model baru yang lebih efisien, mereka tinggal mengganti modul inferensi dan mengulang pengujian.

Dalam organisasi, perluasan akses membuat “biaya eksperimen” turun. Dulu, mencoba tiga arsitektur berarti menulis banyak kode dan menanggung risiko hasil yang tidak bisa direproduksi. Sekarang, standar antarmuka dan contoh implementasi mempercepat pembandingan. Ini berpengaruh pada budaya kerja: rapat produk bisa diisi demo nyata, bukan debat asumsi. Namun ada konsekuensi: semakin mudah mencoba, semakin mudah pula tim terjebak mengejar benchmark tanpa memahami konteks. Kematangan ada pada kemampuan memilih metrik yang relevan dengan tujuan pengguna, bukan sekadar skor publik.

Praktik yang makin penting: evaluasi, robust, dan keamanan data

Open source memperbesar peluang audit, tetapi audit tidak terjadi otomatis. Tim yang serius menetapkan “paket uji” internal: contoh data yang mewakili variasi bahasa, dialek, gaya formal-informal, serta kasus sulit. SagaraLab membangun set uji percakapan pelanggan: komplain berlapis, pertanyaan ambigu, dan permintaan yang berpotensi sensitif. Mereka memeriksa apakah model mudah berhalusinasi, apakah ia memberikan saran yang berbahaya, dan apakah ia konsisten saat konteks panjang. Hasil uji ini kemudian menjadi “gerbang rilis” sebelum fitur dipasang ke produksi.

Keamanan data menjadi isu lain. Ketika orang mengunduh model, mereka sering lupa bahwa data pelatihan atau data fine-tuning bisa mengandung informasi pribadi. Praktik anonimisasi, pemisahan lingkungan, dan kontrol akses internal menjadi kebutuhan, bukan opsi. Di sinilah peran proses, bukan hanya teknologi. Jika organisasi ingin mengambil keuntungan dari alat AI terbuka, mereka perlu SOP: siapa boleh mengunggah data, bagaimana menyimpan artefak, dan bagaimana menghapusnya bila diperlukan.

Daftar kebiasaan kerja yang membantu tim memaksimalkan Platform AI

Perluasan akses paling terasa ketika tim mengubah kebiasaan hariannya. Berikut daftar praktik yang terbukti membuat adopsi open source lebih aman dan efektif:

- Mendefinisikan metrik bisnis sebelum memilih model, misalnya waktu respons, tingkat resolusi, atau kepuasan pengguna.

- Menyimpan jejak eksperimen (versi data, parameter, hasil evaluasi) agar keputusan teknis bisa diaudit.

- Menguji pada data lokal untuk menghindari bias bahasa dan konteks budaya yang tidak sesuai.

- Membuat “red team” internal yang sengaja mencari celah: prompt injection, keluaran berbahaya, atau kebocoran data.

- Menetapkan kebijakan lisensi supaya penggunaan open source tetap patuh aturan dan etika.

Kebiasaan ini terdengar administratif, tetapi justru itulah penopang inovasi yang stabil. Tanpa disiplin, akses yang luas bisa berakhir pada model yang bagus di demo namun rapuh di dunia nyata. Berikutnya, kita akan melihat bagaimana komunitas AI menjadi mesin utama yang mendorong kualitas, kecepatan perbaikan, dan penyebaran praktik terbaik.

Komunitas AI sebagai mesin inovasi: kolaborasi, review, dan distribusi alat AI

Jika model adalah “produk”, maka komunitas AI adalah “pabrik” yang membuatnya terus membaik. Perluasan akses di Hugging Face memperlihatkan bahwa inovasi tidak selalu lahir dari satu lab besar; sering kali ia muncul dari percakapan di issue tracker, perbaikan kecil pada dokumentasi, atau eksperimen yang dibagikan ulang dengan jujur—termasuk kegagalan. SagaraLab mengalami ini saat mereka menemui bug tokenisasi pada data percakapan yang bercampur bahasa Indonesia dan istilah Inggris. Alih-alih memecahkan sendiri, mereka menemukan diskusi serupa dari kontributor lain, mengikuti patch, lalu mengirimkan catatan tambahan yang membantu pengguna berikutnya.

Di era teknologi AI yang bergerak cepat, komunitas berfungsi sebagai sistem peringatan dini. Saat ada model populer yang ternyata punya kelemahan keamanan, kabar dan mitigasinya sering menyebar lewat komunitas lebih dulu dibanding laporan formal. Ini membuat organisasi yang aktif berpartisipasi punya keuntungan: mereka tidak hanya “mengonsumsi”, tetapi juga mengetahui konteks. Akses yang luas menjadi lebih aman ketika pengetahuan tersebar, bukan disimpan rapat-rapat.

Review komunitas: kualitas naik tanpa menunggu vendor

Model open source sering diasumsikan “tanpa jaminan”. Namun kenyataannya, review publik dapat menjadi bentuk jaminan yang berbeda: transparan dan berlapis. Ketika banyak orang menguji model pada data yang beragam, kelemahan cepat terlihat. Misalnya, sebuah model ringkas bisa unggul di benchmark bahasa Inggris tetapi menurun pada bahasa daerah. Dengan laporan komunitas, pengguna baru tidak perlu mengulang kesalahan yang sama. Mereka bisa memilih model yang cocok atau melakukan fine-tuning dengan lebih terarah.

Di sektor kreatif, pola serupa terjadi pada AI generatif: kualitas, gaya, dan kontrol kreatif berkembang berkat iterasi terbuka. Untuk gambaran tentang bagaimana AI generatif dipakai dalam alur kerja kreatif, rujukan seperti pembahasan AI generatif di ekosistem Adobe membantu memperlihatkan hubungan antara alat produksi profesional dan ekosistem riset yang lebih terbuka. Bagi pembaca, ini menegaskan bahwa open source bukan dunia terpisah; ia sering menjadi fondasi ide yang kemudian dipoles menjadi produk siap pakai.

Distribusi alat AI: dari demo hingga integrasi produksi

Perluasan akses bukan hanya menyediakan model, tetapi juga memperbanyak cara orang memakainya. Banyak tim memulai dari demo interaktif untuk menguji “apakah ini masuk akal bagi pengguna”. Setelah itu, mereka beralih ke integrasi: API internal, pipeline batch, atau layanan real-time. Kunci suksesnya ada pada transisi mulus dari eksperimen ke produksi. SagaraLab membuat langkah kecil: mereka menempatkan model di layanan terpisah, menambahkan logging, lalu membangun “saklar” untuk rollback bila kualitas turun. Ini adalah bentuk kehati-hatian yang sering dipelajari dari cerita komunitas—apa yang gagal di tempat lain, dan bagaimana menghindarinya.

Dalam konteks perusahaan besar, komunitas juga membantu rekrutmen dan pelatihan. Kontributor yang aktif biasanya memiliki portofolio nyata: pull request, catatan evaluasi, dan diskusi teknis. Ini mempercepat proses mencari talenta yang tidak hanya paham teori, tetapi juga paham praktik kolaborasi. Insight akhir bagian ini: akses yang luas baru menjadi keunggulan kompetitif ketika organisasi berani terlibat dan memberi kontribusi, bukan sekadar mengambil.

Tata kelola, regulasi, dan etika: memperluas akses tanpa memperluas risiko

Semakin luas akses ke model kecerdasan buatan open source, semakin besar pula tanggung jawab sosial dan organisasi yang menyertainya. Banyak orang mengira risiko hanya soal “model salah menjawab”. Kenyataannya lebih kompleks: ada isu privasi, hak cipta, keamanan siber, hingga dampak pada kelompok rentan. Karena itu, perluasan akses di Platform AI seperti Hugging Face perlu dibaca bersama kebutuhan tata kelola. Bagi SagaraLab, ini berarti membuat kebijakan internal yang jelas: data apa yang boleh dipakai untuk fine-tuning, siapa yang dapat mengubah prompt sistem, dan bagaimana menyaring keluaran yang berpotensi berbahaya.

Isu regulasi juga ikut membentuk cara organisasi mengadopsi AI. Banyak perusahaan yang melayani pasar internasional harus mengikuti aturan lintas wilayah. Ketika ada standar baru, tim tidak bisa sekadar “patch belakangan” karena arsitektur sistem sudah terlanjur dibangun. Mereka perlu memikirkan kepatuhan sejak desain awal. Diskusi seputar kerangka regulasi di berbagai negara menjadi relevan untuk memahami arah kebijakan. Salah satu bacaan yang membantu melihat dinamika ini adalah pembahasan regulasi AI di Uni Eropa, karena pendekatannya sering memengaruhi praktik global, termasuk vendor dan platform yang beroperasi lintas negara.

Model terbuka dan keamanan: mencegah penyalahgunaan tanpa mematikan inovasi

Open source kerap dipertentangkan dengan keamanan, seolah keduanya tidak mungkin sejalan. Padahal, pendekatan yang tepat justru membuat ekosistem lebih tangguh. Salah satu strategi adalah “defense in depth”: pembatasan akses pada komponen sensitif, watermarking pada konten tertentu, moderasi input-output, dan pemantauan anomali. SagaraLab menerapkan filter untuk permintaan yang mengarah pada data pribadi, serta sistem eskalasi ke agen manusia untuk kasus kompleks. Mereka juga membuat kebijakan retensi data percakapan yang ketat, sehingga log tidak menjadi sumber kebocoran.

Hal penting lainnya adalah mengelola risiko “supply chain” model. Ketika tim mengunduh dependensi atau model dari repositori, mereka perlu memverifikasi sumber, mengecek checksum bila tersedia, dan membatasi siapa yang dapat memperbarui versi di produksi. Praktik ini mirip dengan keamanan perangkat lunak pada umumnya, hanya saja konteksnya teknologi AI dengan artefak besar dan sering berubah. Dengan akses yang makin mudah, kontrol internal harus makin rapi agar organisasi tidak membuka pintu serangan.

Etika penggunaan: transparansi kepada pengguna dan batas otomatisasi

Etika sering terdengar abstrak, tetapi dampaknya konkret pada kepercayaan. Pengguna berhak tahu kapan mereka berinteraksi dengan sistem otomatis, bagaimana data mereka dipakai, dan kapan keputusan dialihkan ke manusia. SagaraLab, misalnya, menambahkan label “asisten otomatis” pada kanal chat tertentu, dan menyediakan opsi “hubungi agen” dengan satu klik. Mereka juga membuat panduan internal: AI tidak boleh memberi nasihat medis, hukum, atau finansial tanpa penyangga dan rujukan yang jelas.

Di ranah media sosial, etika dan moderasi menjadi medan uji yang keras: konten masif, konteks beragam, dan risiko misinformasi tinggi. Kebijakan moderasi berbasis AI berkembang cepat, dan kasusnya membantu kita memahami dilema yang serupa pada platform lain. Untuk perspektif, Anda dapat melihat ulasan AI untuk moderasi konten, yang menyoroti bagaimana otomatisasi perlu diseimbangkan dengan kebijakan dan peninjauan manusia. Insight penutup bagian ini: akses yang luas harus diimbangi “rem” yang tepat—bukan untuk memperlambat inovasi, melainkan untuk menjaga kepercayaan dan keberlanjutan.

Strategi implementasi di perusahaan dan startup: memanfaatkan Hugging Face untuk nilai bisnis

Perluasan akses open source menjadi benar-benar berarti ketika diterjemahkan ke hasil bisnis: biaya turun, layanan membaik, dan inovasi lebih cepat. Namun implementasi di organisasi memiliki pola yang berbeda dari eksperimen individu. SagaraLab belajar bahwa memilih model terbaik di benchmark tidak otomatis membuat pelanggan puas. Mereka perlu memetakan perjalanan pengguna, titik friksi, serta “momennya”: kapan AI boleh mengambil alih dan kapan harus mundur. Dari situ, mereka membangun sistem yang memadukan model bahasa untuk memahami intent, model klasifikasi untuk routing, dan template jawaban terkurasi agar akurat. Ini contoh bagaimana alat AI dan model kecerdasan buatan open source dapat disusun seperti lego—asal desainnya disiplin.

Strategi implementasi juga dipengaruhi infrastruktur. Banyak organisasi ingin menjalankan model sendiri (self-host) demi kontrol data dan biaya jangka panjang. Sebagian lain memilih layanan terkelola karena ingin cepat. Tidak ada jawaban tunggal; yang penting adalah menghitung total biaya kepemilikan: komputasi, pemantauan, keamanan, dan tim yang mengoperasikan. Dalam beberapa kasus, model yang lebih kecil dengan sedikit penurunan akurasi justru menang karena latensi rendah dan biaya stabil. Di sinilah tim produk dan tim engineering harus duduk bersama, bukan bekerja berurutan.

Studi kasus fiktif SagaraLab: dari repositori open source ke SLA produksi

Langkah SagaraLab dimulai dari memilih beberapa kandidat model di Hugging Face, lalu menguji dengan dataset internal yang dianonimkan. Mereka menemukan bahwa model A unggul untuk ringkasan, tetapi model B lebih konsisten untuk pertanyaan berulang. Alih-alih memaksa satu model untuk semua, mereka membuat orkestrasi: permintaan ringkas diarahkan ke model A, permintaan FAQ ke model B, dan kasus sensitif ke agen manusia. Hasilnya, waktu respons turun, dan beban agen berkurang tanpa mengorbankan kualitas.

Setelah itu, mereka menambahkan lapisan evaluasi harian: sampel percakapan diperiksa, skor kepuasan dibandingkan, dan “daftar larangan” prompt diperbarui. Mereka juga menetapkan SLA: jika latensi melewati ambang, sistem otomatis beralih ke jawaban template. Ini contoh penting: akses open source mempercepat awal, tetapi kualitas produksi ditentukan oleh operasi yang konsisten. Tanpa monitoring, sistem akan memburuk diam-diam seiring perubahan perilaku pengguna.

Integrasi dengan tren perangkat dan infrastruktur AI

Ekosistem AI tidak berdiri sendiri; ia terkait chip, jaringan, dan perangkat konsumen. Ketika model makin efisien, sebagian pemrosesan dapat dipindahkan ke perangkat, mengurangi beban server. Ini terlihat pada tren chip AI di ponsel dan laptop, yang membuat pengalaman lebih privat dan cepat. Di sisi lain, pusat data juga berkembang dengan akselerator baru. Mengikuti perkembangan ini membantu organisasi menentukan kapan harus inference di cloud dan kapan di edge. Jika Anda ingin memahami arah perangkat konsumen, bacaan seperti pembahasan chip AI untuk smartphone memberi konteks tentang mengapa model kecil dan teroptimasi makin penting.

Pada akhirnya, strategi terbaik adalah yang menghubungkan tiga hal: tujuan bisnis, kemampuan teknis, dan tata kelola. Perluasan akses di Platform AI memberi bahan bakar inovasi, tetapi kemudi tetap berada pada organisasi yang mengoperasikannya. Insight akhir: open source mempercepat semua orang, namun pemenangnya adalah tim yang paling rapi mengubah eksperimen menjadi layanan yang dapat dipercaya.