Di balik ledakan layanan generatif, asisten kerja, hingga pusat data yang menampung miliaran permintaan harian, ada satu pertanyaan yang kini makin sering terdengar di ruang rapat para eksekutif teknologi: siapa yang sanggup memasok prosesor paling efisien, paling stabil, dan paling cepat untuk kebutuhan aplikasi kecerdasan buatan? Jawaban yang kerap muncul mengarah pada Perusahaan manufaktur semikonduktor dari Taiwan, yakni TSMC. Ketika perusahaan-perusahaan perangkat lunak berlomba memperbarui fitur AI, pabrikan perangkat keras harus mengimbangi dengan kapasitas, kualitas, serta ketepatan pengiriman. Dalam konteks inilah berita tentang peningkatan produksi prosesor AI terasa relevan: bukan sekadar isu industri, melainkan fondasi yang menentukan kecepatan inovasi global. Banyak orang melihat AI sebagai “software yang pintar”, padahal di lapisan terdalam, kemajuan AI bergantung pada chip yang dicetak dengan presisi ekstrem. Ketika TSMC menggenjot produksi untuk beban kerja AI—mulai dari pelatihan model raksasa sampai inferensi real-time—dampaknya merambat ke harga perangkat, strategi cloud, bahkan arah riset. Dari pabrik di Hsinchu hingga pusat data di berbagai benua, rantai nilai ini bergerak seperti satu mesin besar yang disetel untuk era teknologi baru.

Perusahaan chip Taiwan TSMC dan logika peningkatan produksi prosesor AI

Dalam ekosistem semikonduktor, TSMC menempati posisi unik: ia bukan sekadar produsen chip, melainkan “pabrik bersama” bagi banyak perancang prosesor paling berpengaruh di dunia. Model bisnis foundry membuat TSMC tidak perlu menjual merek prosesor sendiri; ia fokus pada manufaktur paling sulit: menyusutkan transistor, meningkatkan yield, dan menjaga konsistensi produksi pada skala raksasa. Ketika permintaan aplikasi kecerdasan buatan melonjak, logika peningkatan kapasitas menjadi lebih kompleks daripada sekadar menambah jam kerja mesin.

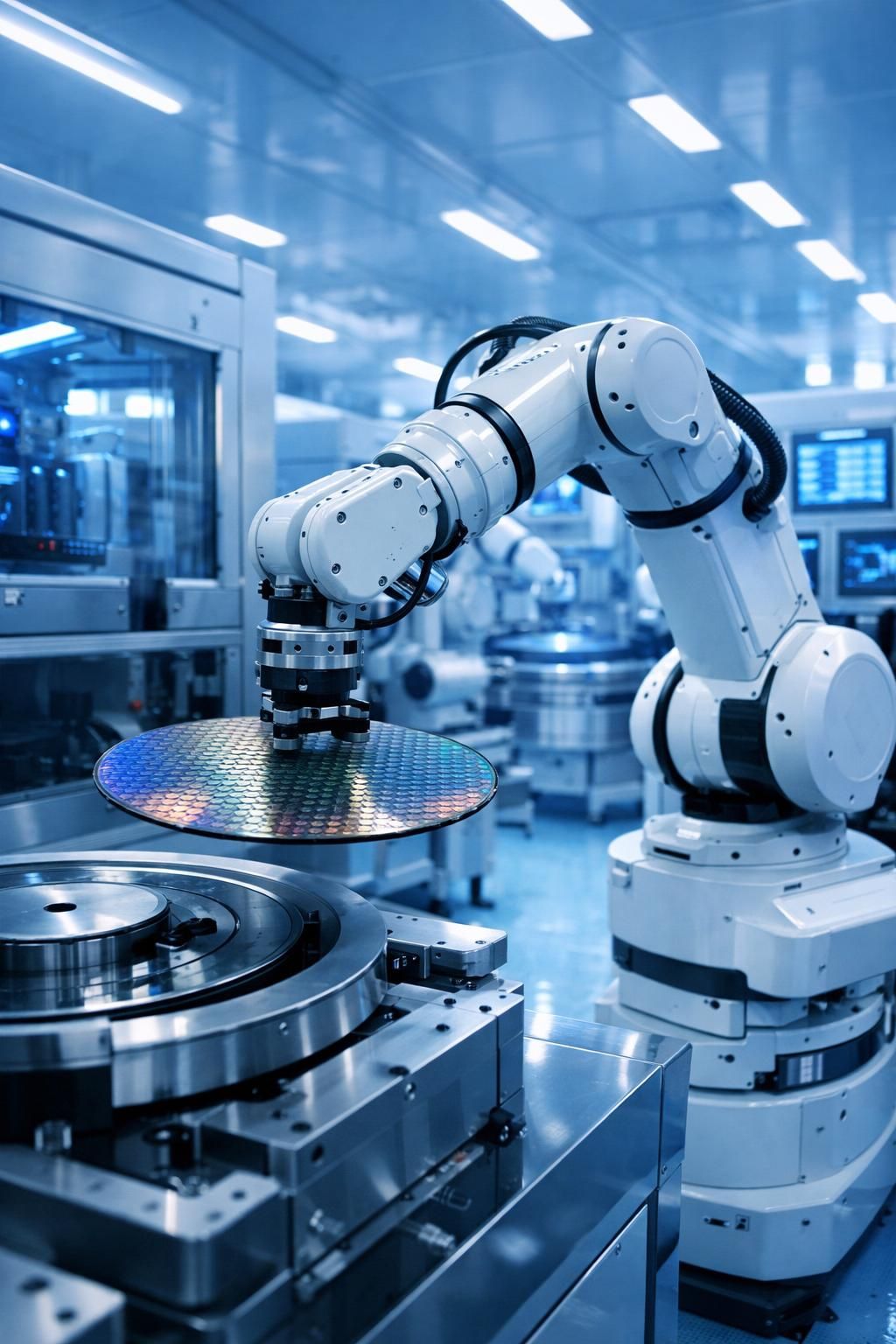

Bayangkan sebuah perusahaan fiktif bernama NusantaraCloud yang ingin memperluas layanan AI untuk sektor perbankan. Mereka tidak cukup membeli GPU atau akselerator; mereka harus memastikan pasokan jangka panjang, karena pelatihan model dan penyediaan inferensi memerlukan ribuan unit yang identik. Jika pemasok chip terlambat, seluruh roadmap layanan tertunda. Pada titik ini, TSMC membaca sinyal pasar bukan dari satu pelanggan, tetapi dari akumulasi permintaan ratusan perusahaan: penyedia cloud, produsen server, pembuat ponsel, hingga startup robotika. Peningkatan produksi berarti mengalihkan sebagian kapasitas node proses canggih untuk komponen yang paling dibutuhkan AI: compute die, HBM interface controller, dan interposer untuk paket 2.5D/3D.

Namun, menggenjot output bukanlah tindakan linear. Setiap wafer yang diproses pada node mutakhir menuntut rantai pasok bahan kimia ultra-murni, gas khusus, photomask kompleks, serta alat litografi berpresisi tinggi. Di sinilah TSMC sering disebut “penjaga gerbang” percepatan AI: kualitas proses manufaktur mereka menentukan seberapa hemat energi sebuah prosesor, seberapa tinggi clock stabilnya, dan seberapa kecil panas yang dibuang dalam rak server yang padat. Jika efisiensi membaik beberapa persen saja, operator pusat data bisa menghemat biaya listrik dan pendinginan dalam skala jutaan dolar per tahun.

Perubahan permintaan juga memaksa penataan portofolio produksi. Dulu, lonjakan utama datang dari ponsel flagship musiman. Kini, banyak volume bergeser ke server AI yang ritmenya berbeda: kontrak besar, siklus pengadaan panjang, dan toleransi kegagalan yang rendah. Dampaknya terasa hingga kebijakan pemeliharaan mesin: downtime alat harus dijadwalkan lebih ketat karena pelanggan AI biasanya memesan batch besar dengan tanggal pengiriman yang sulit digeser. Pada akhirnya, alasan mendasar peningkatan produksi bukan hanya “lebih banyak pesanan”, melainkan kebutuhan untuk menstabilkan arus pasokan ketika AI menjadi lapisan dasar ekonomi digital. Dan ketika stabilitas menjadi mata uang baru, manufaktur presisi menjadi panggung utamanya.

Setelah kapasitas dasar dipahami, pertanyaan berikutnya mengarah ke bagaimana prosesor AI itu sendiri dirakit dan dioptimalkan—yang membawa kita ke inovasi kemasan dan arsitektur.

Teknologi kemasan canggih: kunci produksi prosesor untuk aplikasi kecerdasan buatan

Jika dulu kompetisi semikonduktor identik dengan “node proses” (misalnya mengecilkan transistor), era aplikasi kecerdasan buatan menambahkan babak baru: kemasan canggih dan integrasi memori. Banyak beban kerja AI bukan semata soal komputasi mentah, melainkan seberapa cepat data dapat dipindahkan dari memori ke unit komputasi. Di sinilah teknologi paket 2.5D/3D, interposer, dan chiplet menjadi penentu, sekaligus alasan mengapa TSMC meningkatkan kemampuan manufaktur di luar litografi.

Kita bisa melihatnya melalui studi kasus hipotetis: sebuah vendor server merancang akselerator AI dengan beberapa chiplet komputasi dan tumpukan memori HBM. Secara teori, desain ini menawarkan performa tinggi. Dalam praktik, tantangannya ada pada penyambungan mikro (micro-bump), kualitas interkoneksi, dan disipasi panas. Jika satu area paket mengalami hotspot, performa menurun atau umur perangkat memendek. Teknologi kemasan seperti CoWoS dan varian integrasi 3D membantu memperpendek jarak sinyal sekaligus meningkatkan bandwidth memori, membuat inferensi model besar menjadi lebih responsif.

Di lapangan, peningkatan produksi prosesor AI berarti menambah kapasitas tidak hanya untuk mencetak die, tetapi juga untuk tahap packaging yang lebih rumit. Packaging kini menjadi bottleneck yang sering dibicarakan industri: permintaan untuk paket ber-bandwidth tinggi melonjak, sementara prosesnya memerlukan lini khusus, material mahal, dan kontrol kualitas ketat. Ketika orang mendengar “kekurangan chip”, sering kali yang sebenarnya kurang bukan wafer mentah, melainkan kemampuan mengemas die dan memori menjadi modul yang siap dipasang di server.

Hubungannya dengan dunia perangkat lunak juga nyata. Ambil contoh adopsi asisten kerja berbasis AI pada sistem operasi dan aplikasi produktivitas. Ketika fitur AI seperti yang dibahas dalam ulasan Microsoft Copilot di Windows makin sering dipakai, sebagian beban komputasi dapat bergeser antara perangkat lokal dan cloud. Agar pengalaman pengguna tetap mulus, pusat data membutuhkan akselerator yang tidak hanya cepat, tetapi juga efisien dalam inferensi. Kemasan canggih membantu mengurangi latensi dan konsumsi daya, yang pada akhirnya berpengaruh pada biaya layanan dan kualitas pengalaman pengguna.

Dari sisi manufaktur, TSMC harus memastikan setiap tahap—dari wafer hingga paket akhir—memiliki yield tinggi. Yield bukan sekadar angka; ia menentukan apakah sebuah batch produksi menguntungkan atau justru menjadi beban biaya. Untuk prosesor AI bernilai tinggi, kegagalan kecil pada interkoneksi bisa berarti kerugian besar. Karena itu, investasi pada inspeksi optik, metrologi, dan otomatisasi menjadi bagian integral dari teknologi produksi modern. Insight pentingnya: di era AI, pemenang bukan hanya yang punya transistor terkecil, melainkan yang mampu mengirim modul komputasi lengkap dengan bandwidth memori yang “tidak tersendat”.

Dengan kemasan dan pasokan yang makin matang, dampak berikutnya terlihat pada peta kompetisi global—termasuk China, Amerika, dan dinamika inovasi perangkat lunak yang turut mendorong permintaan.

Perubahan permintaan AI juga memengaruhi strategi konten dan layanan di seluruh dunia, dari model bahasa hingga pembuatan media generatif, yang pada akhirnya kembali menekan kebutuhan prosesor berperforma tinggi.

Dampak peningkatan produksi chip TSMC terhadap ekosistem AI global

Ketika Perusahaan seperti TSMC menaikkan produksi chip untuk aplikasi kecerdasan buatan, efeknya menjalar seperti gelombang: dari harga komputasi cloud, ketersediaan server, hingga kecepatan riset model. Pusat data besar biasanya membeli akselerator dalam jumlah yang membuat industri lain terlihat kecil. Satu klaster pelatihan model dapat menghabiskan ribuan prosesor, dan setiap penundaan pengiriman bisa menggeser jadwal peluncuran produk global.

Di sisi kompetisi geopolitik, peningkatan produksi di Taiwan juga berpengaruh pada strategi negara lain yang ingin memperkuat rantai pasok semikonduktor. Namun, faktor paling terasa bagi publik adalah stabilisasi harga komputasi. Saat pasokan akselerator membaik, perusahaan rintisan AI dapat menyewa GPU/TPU/akselerator lain dengan tarif yang lebih rasional, sehingga inovasi tidak hanya dimonopoli pemain besar. Jika biaya inferensi turun, lebih banyak layanan dapat menawarkan fitur AI tanpa membebankan biaya tinggi kepada pengguna akhir.

Perkembangan model AI di China dan wilayah lain juga ikut memanaskan permintaan. Misalnya, ketika publik mengikuti kemajuan model seperti yang sering dibahas dalam konteks Baidu AI Ernie di China, yang terlihat hanyalah kemampuan percakapan atau penalarannya. Di balik layar, model seperti itu memerlukan pipeline pelatihan, fine-tuning, dan inferensi yang semuanya menuntut prosesor yang kencang dan hemat daya. Ketika banyak pemain mengembangkan model mereka sendiri, kebutuhan akan pasokan chip menjadi lebih merata dan terus-menerus, bukan musiman.

Yang menarik, dampak juga merembet ke industri kreatif. Generasi baru alat desain dan video berbasis AI memerlukan komputasi besar, terutama jika fitur real-time semakin umum. Pembaca yang mengikuti perkembangan AI generatif Adobe akan melihat bagaimana pembuatan konten menjadi lebih cepat, namun di balik kemudahan itu ada permintaan komputasi yang meningkat di sisi cloud maupun workstation. Maka, peningkatan kapasitas produksi prosesor AI secara tidak langsung menentukan seberapa cepat fitur kreatif baru bisa tersedia secara luas.

Dalam konteks bisnis, perusahaan seperti NusantaraCloud (contoh kita) akan merasakan dampak pada dua hal: kemampuan scaling dan keandalan layanan. Dengan pasokan lebih stabil, mereka bisa merencanakan ekspansi klaster inferensi untuk nasabah e-commerce saat puncak belanja, atau menambah kapasitas analitik fraud untuk bank tanpa takut kehabisan hardware. Keandalan ini juga memengaruhi kepatuhan: di sektor finansial dan kesehatan, audit sering menuntut konsistensi performa dan pencatatan beban kerja. Jika infrastruktur sering berubah karena chip sulit didapat, konsistensi lebih sulit dijaga.

Berikut beberapa dampak konkret yang sering muncul ketika kapasitas produksi prosesor AI meningkat di rantai pasok global:

- Penurunan waktu tunggu untuk pengadaan server AI, sehingga proyek transformasi digital lebih cepat berjalan.

- Stabilisasi biaya komputasi di cloud, yang membuka peluang bagi startup dan kampus untuk bereksperimen.

- Peningkatan densitas komputasi di pusat data karena prosesor lebih efisien, mengurangi tekanan pada listrik dan pendinginan.

- Lebih banyak inovasi di edge (perangkat lokal) karena sebagian komponen AI bisa diproduksi massal untuk ponsel dan perangkat industri.

- Ekosistem software makin agresif merilis fitur AI karena infrastruktur pendukungnya lebih terjamin.

Insight akhirnya jelas: ketika pasokan prosesor AI membaik, “laju inovasi” terasa lebih merata—tidak hanya untuk raksasa teknologi, tetapi juga untuk pemain menengah yang selama ini menunggu celah kapasitas.

Setelah melihat dampaknya ke ekosistem, langkah berikutnya adalah memahami tantangan operasional yang membuat peningkatan produksi tidak pernah sederhana, termasuk energi, kualitas, dan talenta.

Tantangan produksi: energi, yield, dan rantai pasok saat TSMC menaikkan kapasitas

Meningkatkan produksi chip AI bukan sekadar menambah jumlah wafer yang masuk ke pabrik. Ada tiga tantangan besar yang selalu mengikuti langkah ekspansi: energi dan utilitas, yield dan kualitas, serta rantai pasok dan tenaga kerja terampil. Ketiganya saling terkait, dan setiap keputusan memiliki konsekuensi finansial maupun reputasi bagi TSMC sebagai penyedia manufaktur utama.

Pertama, energi. Pabrik semikonduktor memerlukan pasokan listrik yang stabil, air ultra-murni, serta sistem pengendalian suhu dan kelembapan yang sangat ketat. Ketika kapasitas dinaikkan, kebutuhan utilitas ikut naik. Di Taiwan, isu ketersediaan air dan stabilitas jaringan listrik pernah menjadi sorotan karena pabrik harus menjaga kualitas produksi tanpa fluktuasi. Dalam skenario nyata, satu gangguan kecil pada kualitas air dapat memicu batch cacat, dan itu berarti kerugian besar. Karena itu, peningkatan kapasitas biasanya diiringi investasi pada daur ulang air, redundansi listrik, dan pemantauan berbasis sensor.

Kedua, yield. Pada node proses canggih, margin kesalahan sangat kecil. Debu mikroskopis saja bisa merusak pola transistor. Yield yang turun beberapa persen dapat mengubah proyeksi pasokan global. Untuk prosesor AI yang kompleks, yield bukan hanya soal die, tetapi juga packaging: interkoneksi, solder mikro, dan penumpukan memori. Di sini, otomatisasi inspeksi menjadi krusial. Banyak lini produksi mengandalkan machine vision untuk mendeteksi cacat sedini mungkin, sehingga material mahal tidak terbuang pada tahap akhir. Logikanya mirip dengan kontrol kualitas di industri farmasi: lebih baik mendeteksi dini daripada menarik produk di hilir.

Ketiga, rantai pasok dan talenta. Alat manufaktur semikonduktor memiliki waktu tunggu panjang, begitu juga beberapa material khusus. Peningkatan produksi mendorong kebutuhan photomask lebih banyak, bahan kimia lebih stabil, dan komponen pengganti mesin yang harus tersedia cepat. Selain itu, dibutuhkan teknisi dan insinyur proses yang tidak hanya paham teori, tetapi juga memahami “kepribadian” mesin—bagaimana satu alat bereaksi terhadap perubahan parameter kecil. Karena itu, pelatihan internal dan kolaborasi dengan universitas menjadi bagian dari strategi ekspansi.

Untuk menggambarkan kompleksitasnya, kembali ke NusantaraCloud. Mereka mungkin melihat pasokan akselerator sebagai angka di invoice. Namun, di sisi pabrik, setiap unit itu adalah hasil ratusan langkah proses, ribuan titik pengukuran, dan keputusan operasi yang harus konsisten. Ketika permintaan melonjak, godaannya adalah memaksa throughput lebih tinggi. Tetapi tanpa kontrol, kualitas bisa turun dan merusak kepercayaan pelanggan. Maka, peningkatan kapasitas yang sehat biasanya bersifat bertahap: menambah lini, meningkatkan otomatisasi, memperketat metrologi, lalu mengoptimalkan jadwal produksi berdasarkan mix produk.

Pada akhirnya, tantangan ini menjelaskan mengapa berita “TSMC meningkatkan produksi” seharusnya dibaca sebagai proses multi-tahun yang melibatkan strategi utilitas, kualitas, dan manajemen risiko. Insight penutupnya: di industri semikonduktor, kecepatan hanya bernilai jika ia berjalan bersama ketepatan.

Berikutnya, kita bisa melihat bagaimana semua ini akan memengaruhi desain prosesor dan arah teknologi AI, dari pusat data hingga perangkat sehari-hari.

Perubahan kebutuhan dari pelatihan ke inferensi real-time membuat perancang prosesor mengubah prioritas, dan pabrik harus menyesuaikan lini agar selaras dengan tren tersebut.

Arah teknologi prosesor AI berikutnya: dari pusat data ke edge dan strategi perusahaan

Ketika TSMC menaikkan produksi prosesor untuk aplikasi kecerdasan buatan, implikasinya tidak berhenti pada server kelas berat. Arah teknologi bergerak ke dua jalur sekaligus: akselerator raksasa untuk pelatihan model skala besar, dan prosesor hemat daya untuk inferensi di perangkat edge seperti ponsel, kamera industri, atau perangkat medis. Dua jalur ini sama-sama menuntut inovasi, namun metrik keberhasilannya berbeda.

Di pusat data, tren utamanya adalah “lebih rapat dan lebih hemat.” Perusahaan ingin meningkatkan token per detik per watt, bukan sekadar token per detik. Peningkatan efisiensi ini muncul dari kombinasi desain arsitektur, node proses yang lebih matang, dan kemasan yang mengurangi hambatan data. Dalam praktik, operator data center sering menghitung TCO (total cost of ownership) selama 3–5 tahun. Jika prosesor baru menghemat energi dan mengurangi kebutuhan pendinginan, mereka bisa menunda pembangunan gedung baru. Artinya, chip bukan hanya komponen; ia adalah keputusan investasi infrastruktur.

Di edge, pertanyaannya: seberapa banyak AI yang bisa dipindahkan dari cloud ke perangkat? Ketika inferensi dilakukan lokal, latensi turun dan privasi meningkat. Namun, perangkat edge dibatasi baterai dan ruang. Di sini, manufaktur yang efisien memungkinkan NPU/AI accelerator kecil namun kuat diproduksi massal. Jika biaya per unit turun, produsen perangkat bisa menanamkan fitur AI ke lebih banyak kelas produk, bukan hanya flagship. Ini menciptakan efek “AI merata”, di mana fitur seperti transkripsi offline, deteksi objek, atau ringkasan dokumen menjadi standar.

Menariknya, strategi perusahaan pengguna AI juga berubah. Banyak organisasi tidak lagi bertanya “apakah kita perlu AI?”, melainkan “model mana yang paling masuk akal secara biaya?” dan “apakah inferensi harus di cloud atau di perangkat?” Keputusan tersebut sangat dipengaruhi oleh ketersediaan prosesor. Jika pasokan longgar, perusahaan bisa bereksperimen dengan beberapa arsitektur; jika pasokan ketat, mereka cenderung mengunci vendor dan mengurangi fleksibilitas. Dengan adanya peningkatan produksi, fleksibilitas ini berpotensi kembali, sehingga inovasi lebih kompetitif.

Dalam narasi NusantaraCloud, misalnya, mereka bisa menjalankan strategi hibrida: pelatihan dan fine-tuning di pusat data, sementara sebagian inferensi sensitif dijalankan di perangkat klien (edge gateway) di kantor cabang bank. Untuk ini, mereka butuh dua tipe prosesor: akselerator besar untuk training dan chip hemat daya untuk edge. Ketika manufaktur TSMC mampu memasok keduanya dalam volume, desain solusi menjadi lebih luwes dan tidak memaksa semua beban kerja masuk cloud.

Ke depan, kita juga akan melihat optimalisasi berbasis domain: prosesor yang disetel untuk visi komputer industri, bahasa natural, atau rekomendasi. Ketika AI makin beragam, satu ukuran tidak cocok untuk semua. Produsen chip dan perancang sistem akan menyeimbangkan fleksibilitas (bisa menjalankan banyak model) dengan efisiensi (spesifik untuk satu jenis komputasi). Pabrik seperti TSMC berperan sebagai enabler: makin baik proses dan packaging, makin mudah industri menghadirkan varian prosesor yang berbeda tanpa mengorbankan skala produksi.

Insight penutupnya: peningkatan produksi bukan sekadar menambah jumlah chip, melainkan memperluas pilihan strategi AI—dari data center superpadat hingga edge yang privat—yang pada akhirnya menentukan bagaimana AI hadir dalam kehidupan sehari-hari.